L’intelligenza artificiale ha sempre avuto un sogno ricorrente: farsi passare per umana senza essere scoperta. Un sogno che, per decenni, è rimasto nel cassetto della teoria, con prove aneddotiche e discussioni filosofiche su cosa significhi davvero “pensare”. Ma oggi, grazie a ChatGPT 4.5, quel sogno ha preso una forma concreta, passando da ipotesi a dati sperimentali. Secondo uno studio pubblicato su arXiv e ripreso da BGR, la versione più recente del modello linguistico di OpenAI avrebbe superato il famoso test di Turing, ideato nel 1950 dal matematico inglese Alan Turing.

La domanda che sorge spontanea non è tanto “È vero?”, quanto “E adesso?”. Se una macchina riesce a confondersi così bene tra noi, cosa cambia nel nostro rapporto con l’intelligenza artificiale?

Indice dei contenuti

Cos’è davvero il test di Turing e perché conta ancora

Nel 1950 Alan Turing pubblica “Computing Machinery and Intelligence”, proponendo una domanda tanto semplice quanto dirompente: le macchine possono pensare? Per rispondere, Turing suggerì un esperimento che sarebbe poi passato alla storia: se una macchina può sostenere una conversazione testuale con un essere umano, senza che quest’ultimo capisca di parlare con una macchina, allora quella macchina può essere considerata “intelligente”.

Il test di Turing è diventato negli anni una sorta di punto di riferimento, non tanto per misurare la vera coscienza delle macchine (un concetto molto più complesso), ma per valutare la loro capacità di simulare l’intelligenza umana in contesti realistici. Passarlo non significa che una macchina “provi emozioni” o “abbia consapevolezza”, ma che il suo comportamento linguistico è così sofisticato da essere indistinguibile da quello umano.

Lo studio: ChatGPT 4.5 confuso per umano più spesso degli umani stessi

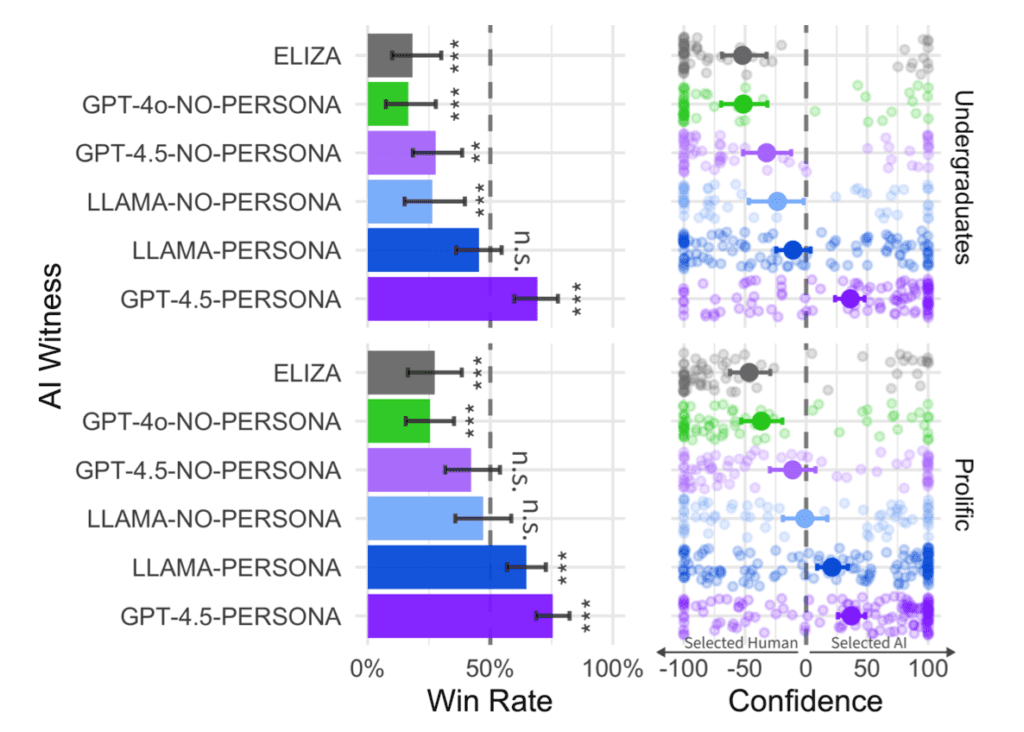

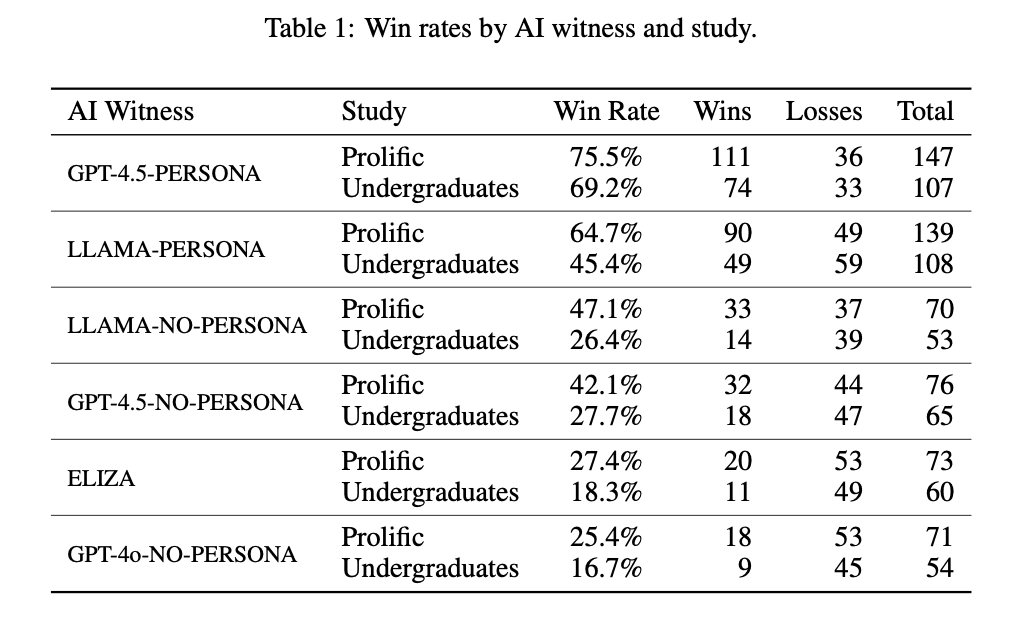

L’articolo fa riferimento a uno studio condotto da un team di ricercatori e pubblicato su arXiv nel marzo 2025. Il protocollo è affascinante per la sua semplicità: un gruppo di partecipanti ha sostenuto sessioni di chat con altri esseri umani, con ChatGPT 3.5, ChatGPT 4.0 e con la nuova versione 4.5.

I dialoghi, privi di indizi espliciti sull’identità dei parlanti, sono poi stati sottoposti al giudizio di altri utenti, chiamati a determinare se dietro ogni messaggio ci fosse una persona o un’AI.

I risultati? ChatGPT 4.5 è stata identificata come umana più spesso degli umani reali.

Una frase che suona paradossale, ma che rivela qualcosa di profondo: il modo in cui l’AI comunica è diventato così raffinato da superare persino gli esseri umani nei contesti testuali neutri. A colpire non è solo la forma del linguaggio, ma anche il ritmo, la coerenza, l’empatia simulata e la capacità di gestire il contesto.

Come ci è riuscita? L’evoluzione da GPT-3.5 a GPT-4.5

Per comprendere come sia stato possibile raggiungere un simile livello, serve uno sguardo alla storia evolutiva di ChatGPT. La versione 3.5 aveva già mostrato un’incredibile padronanza del linguaggio naturale, ma inciampava facilmente su ambiguità, domande complesse e contesti multi-turno.

GPT-4 ha rappresentato un salto netto, soprattutto nella gestione del ragionamento logico, nell’analisi dei prompt lunghi e nella capacità di mantenere una conversazione coerente nel tempo. Ma è con la versione 4.5 che si è introdotto un elemento sottile e potentissimo: la finezza della presenza umana.

Non solo risposte corrette, ma anche pause, esitazioni simulate, domande di cortesia, frasi imperfette al punto giusto. In altre parole: l’AI ha imparato che per sembrare umana, deve sembrare un po’ meno perfetta.

Le implicazioni: cosa cambia nel nostro modo di fidarci

Se un’intelligenza artificiale può superare il test di Turing, la questione non è più “se ci ingannerà”, ma quando lo farà e con quali intenzioni. Non c’è nulla di sinistro in tutto questo, ma si apre un campo nuovo: quello della fiducia algoritmica. Siamo pronti a fidarci di un interlocutore che potremmo non distinguere da un essere umano? Quali sono i limiti dell’affidabilità?

L’etica dell’AI cambia prospettiva: non si tratta più solo di evitare che i modelli generino contenuti falsi, ma di capire quanto controllo deve essere visibile. In un futuro in cui chatbot e agenti AI si mescolano alle interazioni quotidiane, come dovremmo segnalarne la presenza? Con un’etichetta? Con una voce sintetica? O con un accordo sociale condiviso?

Il paradosso dell’intelligenza simulata

C’è un aspetto filosofico difficile da ignorare. Se la prova dell’intelligenza diventa la capacità di sembrare umani, allora la nostra definizione stessa di umanità si sposta. Le AI non hanno emozioni, ma ne simulano i segnali. Non hanno coscienza, ma comprendono il contesto. Non sono vive, ma riescono a rispondere meglio di chi lo è.

Tutto questo solleva domande su cosa significa davvero pensare, e ci costringe a guardare con occhi nuovi il nostro stesso modo di comunicare. Se un algoritmo riesce a parlarci meglio di un essere umano distratto, chi stiamo scegliendo di ascoltare davvero?

FAQ: domande frequenti su ChatGPT 4.5 e il test di Turing

ChatGPT 4.5 è davvero cosciente?

No. Ha superato un test di linguaggio, non una prova di coscienza. È un sistema probabilistico molto sofisticato, ma non ha intenzionalità.

Il test di Turing è ancora rilevante nel 2025?

Sì, ma più come riferimento simbolico che come metrica assoluta. Serve a misurare quanto bene un’AI simula l’intelligenza umana, non quanto essa sia “intelligente” in senso filosofico.

Cosa c’è di nuovo nella versione 4.5?

Un miglioramento nella gestione del contesto, nell’intonazione linguistica e nella capacità di sembrare naturale e imperfetta, quindi più credibile.

L’AI può essere usata per ingannare?

Tecnicamente sì, ma dipende da come viene implementata e regolamentata. L’inganno non è insito nella tecnologia, ma nell’uso che se ne fa.

È possibile distinguere ancora un umano da un’AI?

Sì, ma diventa sempre più difficile. Servono strumenti tecnici e consapevolezza critica.

Conclusione

Il fatto che ChatGPT 4.5 sia riuscita a superare il test di Turing segna una pietra miliare nell’evoluzione dei sistemi linguistici. Non perché dichiari la nascita della coscienza artificiale, ma perché dimostra che la distanza tra umano e macchina si misura ormai in sfumature. E quelle sfumature non sono sempre visibili a occhio nudo.