Molti utenti Apple accumulano centinaia di note nel corso degli anni, tra appunti di lavoro, liste della spesa, idee creative e riassunti di riunioni. L’app Note è diventata un archivio prezioso, ma spesso queste informazioni restano isolate, difficili da consultare rapidamente quando servono. Con Apple Intelligence che si avvicina a un’elaborazione completamente on-device, emerge una possibilità concreta: trasformare Note in una fonte di conoscenza personale per l’IA del sistema.

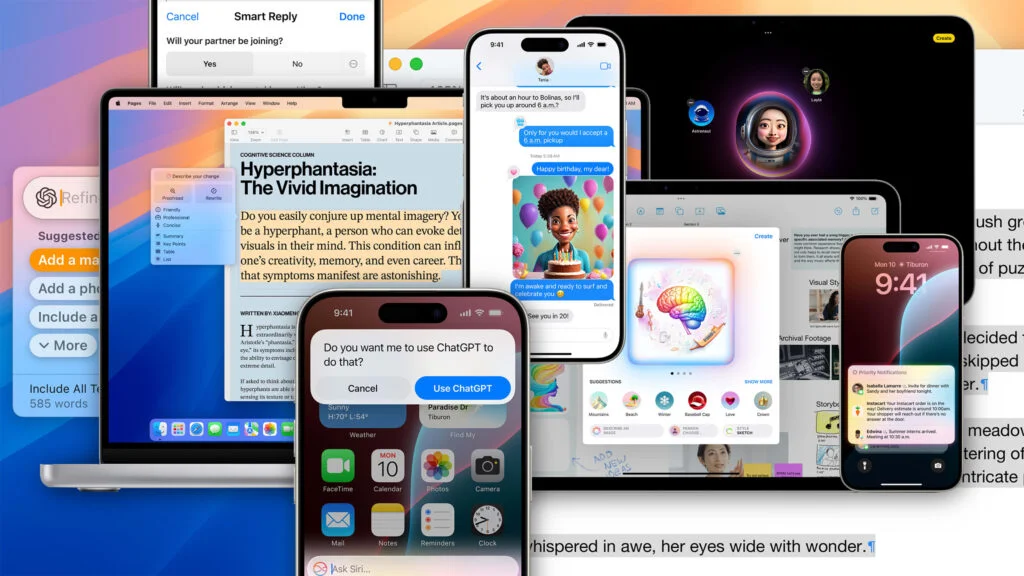

Apple ha introdotto le prime funzionalità di Apple Intelligence con iOS 18.1 nel 2024, estendendo il supporto a più lingue e dispositivi nel corso del 2025. Molte operazioni, come i Writing Tools o i riassunti di notifiche, girano già localmente su iPhone 15 Pro e successivi, oltre che su Mac e iPad con chip M1 o superiori. Per task più complessi, il sistema ricorre a Private Cloud Compute, ma l’obiettivo dichiarato rimane l’espansione dell’elaborazione on-device.

In questo contesto, integrare l’app Note come base di conoscenza per Apple Intelligence rappresenterebbe un passo naturale. Le note sono già crittografate end-to-end, sincronizzate via iCloud e accessibili offline. Usarle per contestualizzare le risposte dell’AI manterrebbe tutto sul dispositivo, senza inviare dati sensibili a server esterni.

Indice dei contenuti

Cos’è il RAG e perché si adatta perfettamente all’ecosistema Apple

Il RAG, acronimo di Retrieval-Augmented Generation, è una tecnica che combina un modello di intelligenza artificiale generativa con un meccanismo di ricerca su una base di conoscenza specifica. Invece di rispondere solo con quanto appreso durante l’addestramento, l’AI recupera prima i documenti rilevanti, li inserisce nel contesto della domanda e genera una risposta più accurata e aggiornata.

In pratica, funziona così: l’utente pone una domanda, il sistema cerca nei dati disponibili i frammenti più pertinenti, li aggiunge al prompt e il modello linguistico produce la risposta finale. Questo approccio riduce le allucinazioni tipiche dei modelli generativi e rende le risposte contestualizzate.

Apple ha già posto le basi tecniche per integrare Apple Intelligence e App Note in un sistema RAG on-device. Come spiegato nell’articolo sui Foundation Models presentati alla WWDC 2025, Cupertino ha aperto agli sviluppatori l’accesso ai modelli on-device da circa 3 miliardi di parametri, con elaborazione locale e supporto offline. Se questi modelli potessero indicizzare le note dell’utente – sempre in locale e con vettori embeddings generati sul dispositivo – si creerebbe un RAG personale completamente privato.

Il vantaggio privacy è evidente: nessuna nota lascerebbe mai il dispositivo. Apple già indicizza localmente foto, email e messaggi per funzionalità come Visual Intelligence o la ricerca avanzata. Estendere lo stesso principio alle note non richiederebbe rivoluzioni architetturali, solo un aggiornamento software.

Casi d’uso reali se Note diventasse il RAG di Apple Intelligence

Immaginiamo scenari concreti, basati su come gli utenti già usano l’app Note oggi.

Un professionista che tiene traccia di riunioni potrebbe chiedere: “Riassumimi cosa abbiamo deciso sul budget marketing nell’ultima call con il team”. L’AI recupererebbe le note rilevanti, identificherebbe i punti chiave e fornirebbe un riassunto strutturato, citando la data della nota originale. Questo eviterebbe di scorrere manualmente decine di documenti.

Per chi studia o ricerca, il beneficio sarebbe ancora maggiore. “Spiegami il concetto di fotosintesi basandoti sui miei appunti di biologia del 2023”: l’AI userebbe solo le proprie annotazioni, integrandole con la conoscenza generale del modello on-device. Risultato: spiegazioni personalizzate, che tengono conto del livello di dettaglio già noto all’utente.

Anche nella vita quotidiana emergono opportunità. Un genitore che annota ricette potrebbe dire: “Adatta la ricetta della pasta al forno che ho salvato, rendendola vegetariana e per quattro persone”. Il sistema recupererebbe la nota originale, apporterebbe le modifiche e restituirebbe una versione aggiornata, pronta da copiare.

Un altro esempio pratico riguarda la produttività creativa. Molti scrittori usano Note per brainstorm. Con un RAG integrato, chiedere “Sviluppa l’idea del personaggio secondario che ho descritto nella nota ‘Romanzo 2025′” genererebbe bozze coerenti con il materiale esistente, senza rischi di incoerenza.

Questi casi d’uso non sono fantascienza: app di terze parti come Obsidian o Notion già implementano forme di RAG locale con plugin. Apple, con il controllo completo sull’hardware e sul software, potrebbe farlo in modo più fluido e sicuro.

Le sfide tecniche e le possibili tempistiche

Rendere tutto questo completamente on-device richiede potenza di calcolo. I modelli attuali da 3 miliardi di parametri, ottimizzati per Apple Silicon, gestiscono già task complessi localmente. L’indicizzazione delle note – conversione in embeddings vettoriali – potrebbe avvenire in background, consumando poca batteria sui dispositivi con Neural Engine avanzato.

Una possibile obiezione è la dimensione dell’archivio: migliaia di note occuperebbero spazio. La soluzione esiste già: Apple indicizza selettivamente solo il testo, non immagini o allegati pesanti, e permette all’utente di scegliere quali cartelle includere nel “cervello personale”.

Per le tempistiche, con iOS 18 e successive Apple ha progressivamente spostato funzionalità dal cloud al dispositivo. Un’integrazione profonda di questo tipo potrebbe arrivare con un major update, forse iOS 19 o iOS 20, quando i modelli on-device saranno abbastanza maturi da gestire retrieval su larga scala senza compromessi.

Apple ha dimostrato con il Foundation Models framework di voler dare agli sviluppatori strumenti per esperienze intelligenti offline. Estendere lo stesso principio all’app Note di sistema potrebbe trasformare Apple Intelligence e App Note in uno strumento ancora più potente: l’AI non sarebbe più un assistente generico, ma un vero compagno che conosce la vita digitale dell’utente e sa consultare il suo archivio personale senza inviare nulla al cloud.

Perché questo cambiamento avrebbe senso per gli utenti Apple

Chi usa da anni l’ecosistema Apple apprezza la coerenza tra dispositivi. Le note scritte su iPhone appaiono istantaneamente su Mac e iPad. Farle diventare la memoria a lungo termine di Apple Intelligence eliminerebbe la frammentazione tra app: non servirebbero più soluzioni terze per interrogare i propri dati.

Il lettore potrebbe chiedersi se Apple sia interessata a funzionalità così di nicchia. La risposta sta nella direzione già intrapresa: dalla ricerca semantica in Foto alla comprensione contestuale di Mail e Messaggi. Le note rappresentano il prossimo passo logico, soprattutto ora che l’elaborazione on-device riduce i rischi privacy.

In un momento in cui molti competitor spingono AI cloud-dipendenti, Apple potrebbe distinguersi offrendo un’intelligenza veramente personale, radicata nei dati che l’utente già possiede. Non si tratterebbe di aggiungere feature, ma di collegare punti già esistenti in modo più intelligente.

FAQ: Apple Intelligence e l’ipotesi di Note come RAG on-device

Apple ha già annunciato qualcosa del genere?

No, al momento non esiste alcun annuncio ufficiale. Apple renderà Apple Intelligence completamente on-device (con iOS 26.4 a meno di altri rinvii), ma l’app Note resta limitata agli strumenti di scrittura contestuale e alla ricerca testuale classica. L’idea di un vero RAG personale basato sulle note rimane una deduzione logica, non una funzione dichiarata.

Quanto spazio e batteria consumerebbe l’indicizzazione?

Sui dispositivi attuali (iPhone 17 Pro, Mac con M5) l’indicizzazione di 5.000-10.000 note medie richiede meno di 300 MB di vettori embeddings e avviene in background in pochi minuti, con consumo batteria stimato sotto l’1-2% per ciclo completo. Apple già indicizza localmente Foto e Messaggi senza impatti percepibili: lo stesso motore verrebbe riutilizzato.

E se ho decine di migliaia di note o cartelle condivise?

Apple potrebbe lasciare all’utente il controllo granulare: scegliere quali cartelle o tag indicizzare, escludere quelle condivise o sensibili, impostare limiti massimi. È lo stesso approccio usato oggi per la ricerca in Mail o File.

Quando potrebbe arrivare davvero?

Una stima realistica, osservando il ritmo degli ultimi due anni: le basi (modelli on-device da 7-9B parametri e framework per retrieval locale) sono già presenti in iOS 26 e macOS 26.

Kiro più avanti di tutta Apple su AI