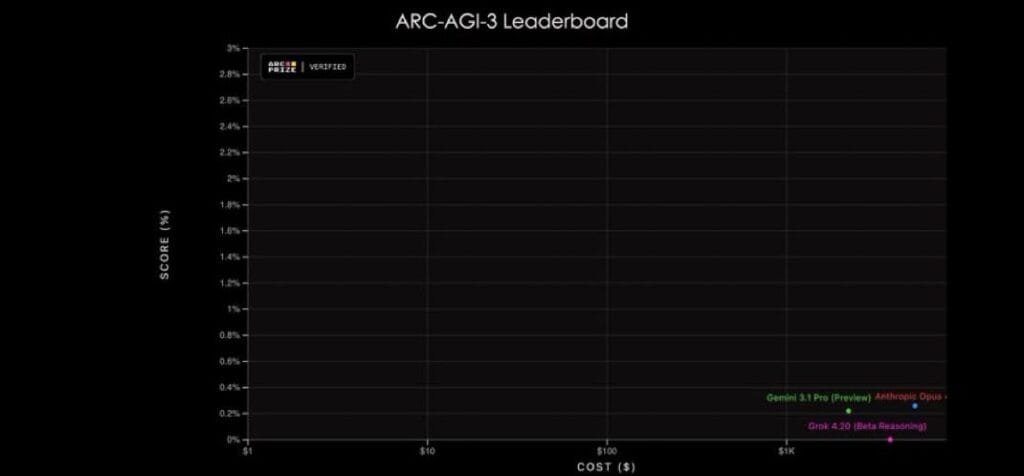

ARC-AGI 3: c’è un numero che sintetizza la distanza tra i modelli di intelligenza artificiale di oggi e l’AGI meglio di qualsiasi analisi teorica. È 0,37%. Tanto vale la prestazione di Gemini 3.1 Pro — il modello più performante nella classifica attuale del benchmark — rispetto a una baseline umana fissata al 100%.

Il test è stato lanciato il 25 marzo 2026 dall’ARC Prize Foundation, l’organizzazione no-profit legata a François Chollet, il ricercatore di Google noto per aver introdotto il progetto ARC nel 2019. L’obiettivo dichiarato di ARC-AGI 3 è misurare quanto un agente AI si avvicina al tipo di intelligenza adattiva che gli esseri umani danno per scontato: esplorare ambienti sconosciuti, capirne le regole da zero, agire con efficienza — senza istruzioni.

I dati della classifica parlano da soli. GPT 5.4 di OpenAI segna 0,26%. Opus 4.6 di Anthropic si ferma a 0,25%. Grok-4.2 di xAI è ferma a 0%. Non si tratta del fallimento di un singolo modello: è un verdetto che riguarda l’intera architettura su cui i large language model sono costruiti. Sanno rispondere, sanno sintetizzare, sanno ragionare su ciò che hanno già visto. Ma davanti a qualcosa di completamente sconosciuto, la loro efficienza adattiva crolla quasi a zero.

Lo stesso Chollet ha commentato su X: “Sub-1% scores from frontier models on the private test set. If you want to be among the first to know when an AGI breakthrough happens, monitor the ARC-AGI-3 leaderboard.”1Fonte: François Chollet su X, marzo 2026 Una battuta che vale più di molti comunicati stampa.

Indice dei contenuti

Come funziona ARC-AGI 3: ambienti senza istruzioni

Le prime due versioni del benchmark — ARC-AGI 1 e ARC-AGI 2 — testevano il ragionamento statico: presentavano coppie input/output su una griglia visiva, e il modello doveva identificare il pattern per applicarlo a un nuovo caso. Un compito difficile, ma con confini ben definiti. Chi è curioso di vedere come si posizionano i modelli in confronti diretti, può approfondire nell’analisi ChatGPT Plus vs Claude Pro.

ARC-AGI 3 rompe questo schema. Ogni ambiente è un gioco a turni con una logica interna propria. Non ci sono istruzioni. Non ci sono obiettivi dichiarati. Non ci sono condizioni di vittoria esplicite. L’agente osserva uno stato visivo, compie un’azione, osserva il risultato, e deve costruire da solo — passo dopo passo — una comprensione di cosa sta succedendo e come procedere.

Il benchmark conta oltre 1.000 livelli distribuiti su 150 ambienti distinti. Ogni ambiente ha la propria grammatica visiva, le proprie regole implicite, la propria logica di feedback. Non è possibile memorizzare le soluzioni. Non è possibile recuperare dall’addestramento una risposta già vista.

La metrica di valutazione è altrettanto insolita: non si conta quante sfide un agente risolve, ma quante azioni servono per risolverle rispetto a un campione umano. È una misura di efficienza adattiva — quanto rapidamente un’intelligenza impara le regole di un gioco mai incontrato prima. Gli esseri umani sono il 100% di riferimento; i modelli che partecipano ad ARC-AGI 3, come mostrano i dati, partono quasi da zero.2Fonte: ARC Prize Foundation, ARC-AGI 3, 2026

La classifica di ARC-AGI 3: i modelli sotto la lente

Il leaderboard di ARC-AGI 3 mostra una situazione uniforme tra i modelli commerciali:

| Modello | Punteggio su ARC-AGI 3 |

|---|---|

| Gemini 3.1 Pro | 0,37% |

| GPT 5.4 | 0,26% |

| Opus 4.6 | 0,25% |

| Grok-4.2 | 0% |

Va contestualizzato: nella fase di developer preview condotta nelle settimane precedenti al lancio ufficiale, il miglior punteggio registrato era stato del 12,58% — ottenuto da sistemi non-LLM ottimizzati specificamente per questo tipo di test. Approcci basati su ricerca grafica esplicita, tracciamento di stato e esplorazione sistematica hanno battuto ogni modello linguistico di frontiera con un margine sostanziale. È un tema su cui vale la pena soffermarsi: già modelli open source come GLM-5 dimostrano che l’architettura conta spesso quanto la scala. Il che aggiunge un elemento interessante: non è detto che la strada verso l’AGI passi necessariamente dai transformer.

Cosa significano questi numeri in concreto? Che per ogni 100 azioni con cui un essere umano risolve un livello con efficienza ottimale, i modelli AI ne impiegano proporzionalmente molte centinaia di più. Quando ci riescono. Nella maggior parte dei casi non ci riescono affatto.

Il divario non è tecnico nel senso tradizionale. Non è una questione di velocità di calcolo, di dimensione del modello o di quantità di dati. È strutturale: i modelli attuali eccellono nel riconoscimento di pattern già visti, ma mostrano una fragilità acuta davanti all’esplorazione aperta — la capacità che Chollet chiama generalizzazione verso compiti veramente nuovi.

Perché il benchmark AGI è ancora irrisolvibile per le macchine

Il termine AGI viene usato in modo tanto frequente quanto impreciso. In senso stretto, indica un sistema capace di affrontare qualsiasi compito cognitivo che un essere umano può svolgere, con flessibilità e generalizzazione comparabili. Non un sistema specializzato, per quanto potente: un sistema davvero adattivo.

ARC-AGI 3 è stato progettato come strumento di misurazione per questo obiettivo specifico. La premessa è semplice: se un modello riesce a esplorare ambienti completamente sconosciuti, impararne le regole in tempo reale e agire con un’efficienza paragonabile a quella umana, allora ha dimostrato una capacità fondamentale dell’intelligenza generale.

I punteggi attuali — tutti sotto lo 0,4% per i modelli commerciali — suggeriscono che questa capacità è ancora assente. Non è il fallimento dei singoli modelli: è il riflesso di un’architettura costruita per compiti diversi. I large language model sono macchine di compressione della conoscenza passata. Sono straordinari nel recuperare e sintetizzare ciò che hanno già visto. Ma davanti a un gioco mai visto prima, senza istruzioni e senza contesto, quella capacità è quasi nulla.

Va detto con onestà: nessuno si aspettava punteggi alti. ARC-AGI 3 è nato esplicitamente per essere irrisolvibile con le architetture attuali. La domanda più interessante non è “chi ha vinto?”, ma “quanto cresceranno questi numeri nei prossimi mesi?”.

Cosa cambia per chi usa l’AI ogni giorno

I punteggi di ARC-AGI 3 potrebbero sembrare una questione da laboratorio. In realtà, il benchmark tocca qualcosa di molto concreto anche per chi usa assistenti AI nel lavoro quotidiano.

Quando si chiede a un modello di completare un compito familiare — riassumere un testo, scrivere codice su un pattern noto, rispondere a una domanda con documenti di riferimento — i risultati sono spesso eccellenti. Ma quando il compito richiede di imparare le regole di un dominio sconosciuto, adattarsi a feedback inattesi, o pianificare in un ambiente che cambia, le limitazioni emergono con regolarità.

Questo non significa che i modelli attuali siano inutili — tutt’altro. Significa che la loro forza è concentrata in un’area specifica: la conoscenza già acquisita. ARC-AGI 3 rende visibile, con un numero preciso, il confine di quella forza.

Per l’utente pratico, la lettura corretta è: affidarsi all’AI per tutto ciò che rientra nel dominio del “già visto”, ma non aspettarsi che raggiunga l’adattabilità umana in situazioni radicalmente nuove — almeno non oggi. Il tema degli agenti AI autonomi è già al centro del dibattito: ne parla in modo diretto l’analisi su quando l’Agentic AI avrà davvero vinto.

Cosa aspettarsi nei prossimi mesi

Seguire l’evoluzione della classifica di ARC-AGI 3 sarà uno degli esercizi più onesti disponibili per capire dove si trova davvero la ricerca sull’intelligenza artificiale.

Se Gemini 3.1 Pro passa dallo 0,37% a qualche punto percentuale entro la fine del 2026, sarà un segnale concreto — non di rivoluzione, ma di progressi verso capacità adattive più solide. Se i punteggi rimangono sotto l’1% per tutto l’anno, sarà un indicatore altrettanto chiaro che la strada è più lunga di quanto i comunicati stampa dei grandi laboratori tendano a far credere.

Il concorso associato mette in palio oltre 2 milioni di dollari in premi, con milestone fissati al 30 giugno e al 30 settembre 2026, e risultati finali annunciati il 4 dicembre. Un incentivo concreto per chi vuole portare quei numeri verso l’alto.

In entrambi i casi, ARC-AGI 3 fa un servizio prezioso al dibattito sull’intelligenza artificiale: trasforma una discussione troppo spesso astratta in una misurazione concreta, riproducibile, paragonabile nel tempo. Non c’è retorica che tenga davanti a uno zero per cento sulla leaderboard.

FAQ

Cos’è ARC-AGI 3?

ARC-AGI 3 è un benchmark interattivo lanciato il 25 marzo 2026 dalla ARC Prize Foundation per misurare quanto i modelli AI si avvicinano all’AGI. A differenza delle versioni precedenti basate su griglie statiche, usa ambienti di gioco senza istruzioni: l’agente deve esplorare, capire le regole e agire in modo efficiente.

Quali modelli AI sono in cima alla classifica ARC-AGI 3?

Al lancio del benchmark (marzo 2026), Gemini 3.1 Pro guida la classifica dei modelli commerciali con 0,37%, seguito da GPT 5.4 con 0,26% e Opus 4.6 di Anthropic con 0,25%. Grok-4.2 di xAI è ferma a 0%. Tutti i punteggi sono riferiti a una baseline umana del 100%.

Perché i punteggi di ARC-AGI 3 sono così bassi?

I punteggi bassi riflettono una differenza strutturale tra i large language model attuali e il tipo di ragionamento testato. ARC-AGI 3 misura la capacità di esplorare e imparare le regole di ambienti mai visti prima, senza istruzioni. I modelli linguistici eccellono nel riconoscere pattern già visti durante l’addestramento, ma mostrano fragilità in scenari genuinamente nuovi.

Chi ha creato ARC-AGI 3?

ARC-AGI 3 è stato sviluppato dalla ARC Prize Foundation, legata a François Chollet — il ricercatore di Google che ha creato Keras e introdotto il progetto ARC nel 2019. Il benchmark è stato presentato ufficialmente il 25 marzo 2026 a San Francisco.

ARC-AGI 3 è diverso da ARC-AGI 1 e 2?

Sì, il cambiamento è sostanziale. ARC-AGI 1 e 2 usavano griglie statiche con coppie input/output: il modello doveva trovare il pattern. ARC-AGI 3 usa invece ambienti interattivi a turni, senza istruzioni: l’agente deve esplorare e imparare le regole da solo. È il primo benchmark della serie che testa il ragionamento interattivo in tempo reale.

Quanto vale il premio di ARC Prize 2026?

ARC Prize 2026 mette in palio oltre 2 milioni di dollari in premi. Le milestone intermedie sono fissate al 30 giugno e al 30 settembre 2026. La chiusura delle submission è prevista per il 2 novembre, con i risultati annunciati il 4 dicembre 2026.

Riferimenti:

- 1Fonte: François Chollet su X, marzo 2026

- 2Fonte: ARC Prize Foundation, ARC-AGI 3, 2026