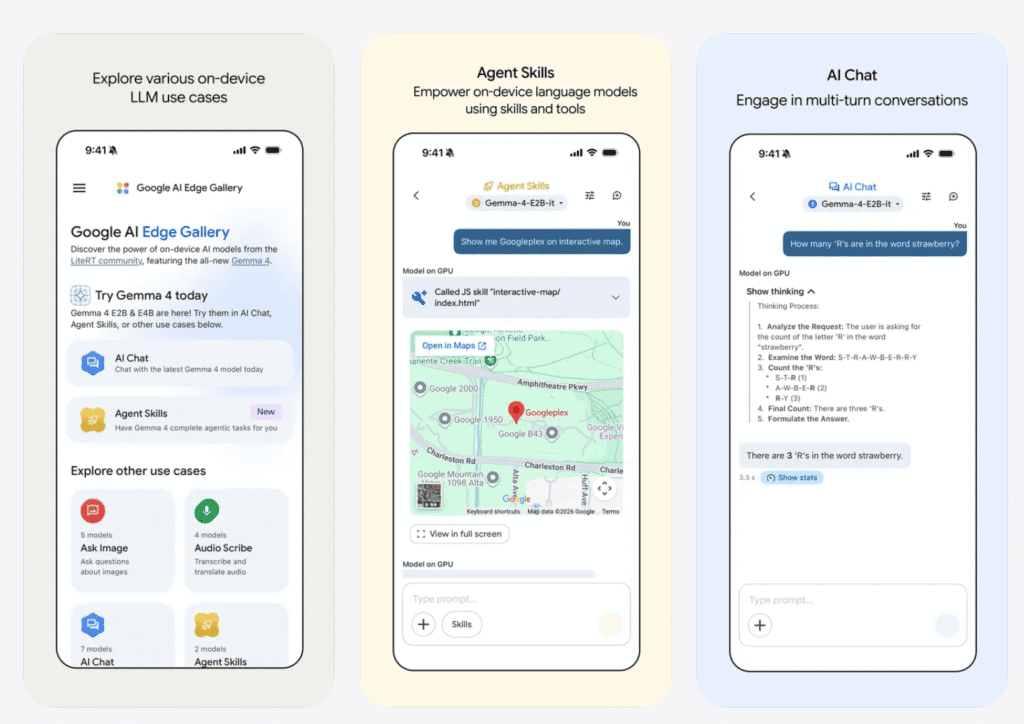

Google AI Edge Gallery è disponibile sull’App Store italiano e porta per la prima volta la possibilità di eseguire modelli di intelligenza artificiale direttamente sul dispositivo, senza connessione a Internet e senza inviare dati a server remoti. L’app è gratuita e supporta modelli come Gemma 3 e il recente Gemma 4, sviluppati da Google DeepMind per funzionare in modo efficiente anche su hardware mobile. Per chi segue l’evoluzione dell’AI on-device — un tema su cui Apple stessa sta investendo con il proprio approccio — questa release è un punto di riferimento concreto.

L’interesse per i modelli locali non è casuale. Negli ultimi mesi la conversazione nell’industria tech si è spostata dalla potenza grezza dei modelli cloud all’efficienza di quelli che girano direttamente sul chip del dispositivo. Con questa app, Google porta il proprio ecosistema AI su iPhone e iPad, sfidando apertamente il paradigma del “tutto in cloud”.

Indice dei contenuti

Cos’è Google AI Edge Gallery e come funziona

Google AI Edge Gallery è un’applicazione sperimentale — classificata da Google come developer preview — pensata per eseguire modelli linguistici di grandi dimensioni (LLM) direttamente sul dispositivo. Nessuna chiamata API, nessun dato che transita su server esterni: tutto avviene in locale, sfruttando il chip del dispositivo.

L’app utilizza il framework MediaPipe di Google, che ottimizza l’inferenza dei modelli per hardware mobile. Al primo avvio, l’utente può scaricare uno o più modelli direttamente dall’interfaccia: il catalogo include varianti di Gemma 3 (1B e 4B parametri) e Gemma 4 nella versione da 4B parametri, progettati per bilanciare qualità delle risposte e consumo di risorse.

Una volta scaricato il modello — il download varia tra 1 e 4 GB circa a seconda della variante — l’app funziona completamente offline. L’interfaccia propone due modalità principali:

– Chat: conversazione testuale con il modello, simile a un assistente AI classico

– Ask Image: possibilità di allegare un’immagine e porre domande sul suo contenuto (multimodalità visiva)

L’esperienza è volutamente essenziale: niente cronologia sincronizzata, niente account Google richiesto. L’obiettivo dichiarato è mostrare le capacità dei modelli on-device, non sostituire prodotti consumer come Gemini.

Dispositivi Apple compatibili

I requisiti hardware sono elevati, e non tutti i dispositivi Apple sono supportati.

iPhone compatibili

L’app richiede iOS 17 o versioni successive e almeno 6 GB di RAM:

– iPhone 17, 17 Plus, 17 Pro, 17 Pro Max, iPhone Air

– iPhone 16, 16 Plus, 16 Pro, 16 Pro Max

– iPhone 15 Pro e 15 Pro Max

Gli iPhone 15 standard e 15 Plus dispongono di 6 GB di RAM ma con gestione della memoria più limitata: le prestazioni potrebbero risultare degradate. Gli iPhone 14 e precedenti sono di fatto esclusi.

iPad compatibili

– iPad Pro con chip M1 o successivo (11″ e 12.9″ dal 2021, più i modelli M2, M3, M4)

– iPad Air con chip M1 o successivo (dal 2022)

– iPad mini con chip A17 Pro (settima generazione, 2024)

La RAM disponibile è il vero discriminante: i modelli da 4B parametri richiedono un’allocazione di memoria significativa, e su dispositivi con meno di 6 GB il caricamento può fallire o risultare molto lento.

Come scaricare e configurare l’app

Il processo di installazione è diretto:1Fonte: App Store – Google AI Edge Gallery, 2025

1. Aprire l’App Store e cercare Google AI Edge Gallery oppure seguire il link diretto

2. Scaricare e installare l’app (pochi MB)

3. Al primo avvio, selezionare il modello desiderato dal catalogo interno

4. Attendere il download del modello scelto (connessione Wi-Fi consigliata per i file da 2–4 GB)

5. Iniziare a usare la chat o la modalità Ask Image senza ulteriori configurazioni

Non è richiesto un account Google. L’app chiede solo l’accesso alla libreria foto per la modalità multimodale.

Casi d’uso reali

Assistente testuale offline

La funzione più immediata è quella di un chatbot completamente offline: utile in aereo, in zone con scarsa copertura, o per chi preferisce non affidarsi al cloud per certe conversazioni. Il modello Gemma 4 da 4B parametri offre risposte coerenti su domande generali, sintesi di testi, brainstorming e scrittura assistita.

Analisi di immagini in locale

La modalità Ask Image permette di caricare una foto e interrogare il modello sul suo contenuto: identificare oggetti in una scena, descrivere un’immagine per scopi di accessibilità, analizzare screenshot di documenti. Tutto senza che l’immagine lasci il dispositivo.

Privacy by design

Per professionisti che trattano dati sensibili — avvocati, medici, giornalisti — la possibilità di usare un modello AI senza trasmettere nulla all’esterno è un vantaggio concreto, non solo teorico. Google AI Edge Gallery non registra le conversazioni né le sincronizza altrove.

Sperimentazione per sviluppatori

Essendo una developer preview, l’app è pensata anche per chi vuole testare le capacità di MediaPipe e dei modelli Gemma prima di integrarli in applicazioni proprie. Google fornisce documentazione e strumenti per chi vuole costruire esperienze simili.2Fonte: The Next Web, 2025

Il contesto: modelli locali e la strategia Apple

Google AI Edge Gallery arriva in un momento in cui l’AI on-device è al centro delle strategie di tutti i grandi player. Apple ha costruito l’intera architettura di Apple Intelligence attorno a questo principio: i modelli più sensibili girano sul dispositivo, con il Private Cloud Compute come estensione sicura solo quando necessario.

Apple ha anche annunciato Apple Foundation Models, il framework che consente agli sviluppatori di accedere ai modelli linguistici integrati nel sistema operativo direttamente dalle proprie app. Un approccio diverso da quello di Google: Apple integra i modelli nell’OS e li espone tramite API di sistema; Google distribuisce i propri modelli come app separata che scarica i pesi in autonomia.

I due approcci riflettono filosofie diverse, non una competizione diretta. Apple controlla l’intera catena — hardware, sistema operativo, modelli — garantendo un’integrazione profonda. Google punta sulla portabilità e sull’apertura, portando i propri modelli su qualsiasi piattaforma supportata.

Per l’utente finale, la coesistenza di queste soluzioni è una buona notizia: più scelta, più pressione competitiva sulla qualità e — soprattutto — la conferma che l’AI locale è destinata a diventare la norma, non l’eccezione.

Limiti attuali da considerare

Prima di installare Google AI Edge Gallery, vale la pena conoscere i limiti di questa fase:

– Qualità inferiore ai modelli cloud: Gemma 4 da 4B parametri è significativamente meno capace di GPT-4o o Gemini Ultra. Per compiti complessi, la differenza si sente.

– Consumo di batteria elevato: l’inferenza locale è computazionalmente intensa; sessioni prolungate scaricano la batteria rapidamente.

– Nessuna memoria delle conversazioni: ogni sessione riparte da zero, senza contesto persistente.

– Italiano non ottimizzato: le risposte in italiano sono accettabili ma meno precise di quelle in inglese, lingua per cui i modelli Gemma sono principalmente ottimizzati.

– Stato sperimentale: essendo una developer preview, bug e instabilità sono possibili.

Nonostante i limiti di questa fase iniziale, Google AI Edge Gallery segna un momento significativo per chi usa dispositivi Apple: per la prima volta, un modello AI di Google gira localmente su iPhone e iPad, senza cloud e senza compromessi sulla privacy. La direzione è chiara, e l’app — anche nel suo stato sperimentale — è già uno strumento utile per capire dove sta andando l’intelligenza artificiale su mobile.

FAQ

Google AI Edge Gallery è gratuita su App Store?

Sì, Google AI Edge Gallery è disponibile gratuitamente sull’App Store italiano. Non richiede abbonamenti né un account Google per funzionare. I modelli AI si scaricano direttamente dall’interno dell’app, anch’essi senza costi aggiuntivi.

Quali modelli AI supporta Google AI Edge Gallery?

L’app supporta varianti della famiglia Gemma di Google DeepMind, tra cui Gemma 3 (1B e 4B parametri) e Gemma 4 (4B parametri). I modelli vengono scaricati localmente e funzionano completamente offline dopo l’installazione. Il catalogo potrebbe espandersi con aggiornamenti futuri.

Google AI Edge Gallery funziona senza connessione internet?

Sì. Una volta scaricato il modello scelto (operazione che richiede una connessione internet), l’app funziona completamente offline. Nessun dato viene trasmesso a server esterni durante l’utilizzo, il che la rende adatta anche in contesti con scarsa copertura o per chi tiene alla privacy.

Quali iPhone e iPad sono compatibili con Google AI Edge Gallery?

L’app richiede iOS 17 e almeno 6 GB di RAM. Su iPhone sono compatibili i modelli iPhone 15 Pro, 15 Pro Max e tutta la serie iPhone 16 e 17. Su iPad sono supportati i modelli con chip M1 o successivo (iPad Pro e iPad Air) e iPad mini con chip A17 Pro. I dispositivi più vecchi non soddisfano i requisiti hardware.

Qual è la differenza tra Google AI Edge Gallery e Apple Intelligence?

Entrambi eseguono modelli AI localmente sul dispositivo, ma con approcci diversi. Apple Intelligence è integrata nel sistema operativo e accessibile tramite API di sistema agli sviluppatori, con modelli ottimizzati per l’ecosistema Apple. Google AI Edge Gallery è un’app separata che scarica i propri modelli Gemma e funziona indipendentemente dal sistema operativo, disponibile anche su Android.

Google AI Edge Gallery è adatta all’uso quotidiano?

L’app è classificata come developer preview, quindi è ancora in fase sperimentale. Per uso quotidiano intenso, i limiti attuali — nessuna memoria delle conversazioni, qualità inferiore ai modelli cloud, consumo elevato di batteria — possono risultare penalizzanti. È ideale per chi vuole esplorare le capacità dei modelli locali o per sviluppatori interessati all’integrazione di Gemma nelle proprie app.

Riferimenti:

- 1Fonte: App Store – Google AI Edge Gallery, 2025

- 2Fonte: The Next Web, 2025