Assistenti AI ovunque significa anche un problema concreto: capire quando l’utente sta davvero parlando con loro. Oggi la scena è familiare: un “Ehi…” detto a un amico, una battuta in salotto, un podcast in auto, e un assistente che si sveglia, interrompe, registra, risponde a sproposito. È fastidioso, ma soprattutto è un segnale: finché l’assistente vive nel telefono, l’errore è contenuto; quando si sposta su auricolari, occhiali, anelli e collane, l’errore diventa sociale.

Nel 2025 la traiettoria è chiara anche senza fare futurologia: i dispositivi diventano più piccoli, più vicini al corpo e più “ambienti”. L’audio è sempre più centrale, perché è l’unica interfaccia che funziona mentre si cammina, si guida, si cucina, si lavora. E l’audio, per definizione, è ambiguo: non porta con sé un puntatore, non ha un click, non offre un confine netto tra “sto parlando al mondo” e “sto parlando alla macchina”.

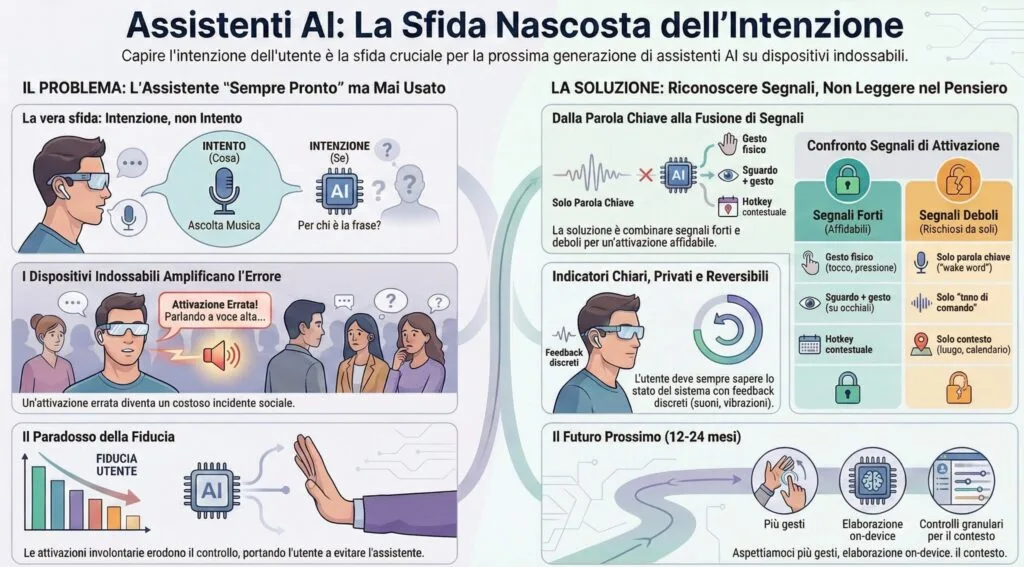

Qui entra in gioco il tema che farà la differenza nella qualità dell’esperienza: l’intenzione dell’utente. Non l’intento della richiesta (“voglio un promemoria”), ma l’intenzione di interagire: sto chiedendo davvero all’assistente di attivarsi? O sto solo parlando, pensando ad alta voce, leggendo un messaggio, imprecando contro il traffico?

Gestire questa soglia è difficile, perché tocca tecnologia, privacy, ergonomia e persino educazione digitale. E chi costruisce assistenti personali, Apple inclusa, dovrà affrontarla con scelte concrete, non con slogan.

Indice dei contenuti

Perché l’“intenzione” è il problema che non si vede

Un assistente non può limitarsi a “capire le parole”. Deve capire se quelle parole sono per lui. È una differenza simile a quella tra sentire e ascoltare: il microfono sente tutto, l’assistente dovrebbe ascoltare solo quando invitato.

Il punto è che, nella vita reale, l’invito non è sempre esplicito. Molti utenti non vogliono pronunciare una formula rigida ogni volta, e non vogliono neppure premere un tasto su un dispositivo che magari non ha schermo, o ce l’ha lontano (un anello), o è scomodo da toccare (occhiali mentre si pedala). Più l’assistente diventa “indossabile”, più cresce la richiesta implicita: capiscimi senza costringermi a un rituale.

Eppure, più l’attivazione è implicita, più il rischio è evidente: attivazioni involontarie, comandi presi dal contesto, risposte fuori luogo. Non è solo una questione di comodità; è anche fiducia. Un assistente che si attiva quando non dovrebbe erode la percezione di controllo, e senza controllo l’utente disattiva, limita, evita. È il classico paradosso: l’assistente “sempre pronto” finisce per essere “quasi mai usato”.

Dalla parola chiave al contesto: cosa non basta più

Per anni la soluzione è stata la wake word (“Ehi Siri”, “Hey Google”). Funziona, ma non è sufficiente. 1La wake word è una parola o frase che innesca l’ascolto attivo; idealmente è riconosciuta localmente, senza inviare audio al cloud, per ridurre il rischio privacy.

Il problema è duplice:

Primo: la wake word è fragile in ambienti rumorosi, con accenti diversi, con audio di sottofondo (TV, social, riunioni). Un sistema tarato per “non perdersi chiamate” tende a essere permissivo e quindi sbaglia di più.

Secondo: la wake word è socialmente “visibile”. In ufficio, in treno, a cena, chiamare l’assistente a voce alta è una scelta che molti evitano. E l’industria lo sa: se gli assistenti diventano davvero personali, devono funzionare anche quando l’utente non vuole performare la richiesta davanti agli altri.

Non a caso, in passato Melamorsicata aveva già colto l’aspirazione verso un assistente più “umano” e conversazionale, evocando l’immaginario di Her. Rileggere oggi Apple vuole Siri parli come l’assistente nel film “Her” è utile per un motivo preciso: la conversazione naturale non è solo linguaggio. È anche turn-taking (capire quando è il proprio turno), discrezione, contesto, e soprattutto il rispetto di un confine.

Il futuro “indossabile” rende l’intenzione più difficile

Quando l’assistente vive in:

- auricolari, l’audio è sempre lì, vicino alla bocca e all’orecchio;

- occhiali, l’assistente ha accesso a segnali visivi e a micro-gesti;

- anelli, può leggere tocchi e micro-interazioni senza dare nell’occhio;

- collane o clip, diventa un “microfono” sempre disponibile.

…la domanda cambia: non è più “come lo attivo”, è “come faccio a non attivarlo”. L’utente non vuole vivere in modalità “hot mic”, e non vuole dover controllare compulsivamente se l’assistente stia ascoltando.

In questi form factor, i falsi positivi diventano più costosi. Un telefono che risponde in tasca è ridicolo; un auricolare che sussurra una risposta mentre si parla con un collega è un incidente relazionale. Un assistente su occhiali che si attiva durante una conversazione delicata è un problema di fiducia e reputazione, non solo di UX.

Un modello pratico: segnali di intenzione, non “telepatia”

Per rendere l’intenzione gestibile, serve un principio: l’assistente non deve indovinare, deve riconoscere segnali chiari e combinati. La strada realistica è una fusione di segnali (multimodale) con soglie e feedback espliciti.

Segnali forti (alta affidabilità, bassa ambiguità)

- Press-to-talk o gesto fisico (pulsante, squeeze, tap sull’auricolare, pressione su anello).

- Gaze + gesto su occhiali/visori (guardare un elemento e confermare con un gesto breve).

- Hotkey contestuale (es. doppio tap quando il telefono è in tasca e gli auricolari indossati).

Questi segnali rispettano un’idea semplice: l’utente fa qualcosa di intenzionale e ripetibile. Il costo è un piccolo attrito, ma l’attrito compra fiducia.

Segnali deboli (utili, ma rischiosi se usati da soli)

- Solo wake word.

- Solo “tono di comando” (la voce quando si dà un ordine).

- Solo contesto (posizione, calendario, vicinanza di altre persone).

Da soli, questi segnali producono errori. In combinazione, possono diventare potenti: wake word + micro-gesture, oppure wake word + prossimità (microfono vicino alla bocca) + assenza di voce altrui.

Il vero salto non è “capire meglio le parole”, è ridurre i falsi risvegli senza rendere l’assistente scomodo.

La sfida Apple: privacy, on-device e aspettative alte

Apple si muove in un campo minato: gli utenti si aspettano assistenti utili, ma anche un livello di privacy superiore alla media. Il tema dell’intenzione è un banco di prova, perché richiede di analizzare segnali sensibili (voce, contesto, eventualmente sguardo e gesti).

Qui un punto resta verificabile e coerente con la direzione storica dell’azienda: quando possibile, Apple tende a spingere l’elaborazione on-device e a raccontare la privacy come valore di prodotto. Per chi vuole un riferimento stabile e ufficiale, la pagina Apple Privacy chiarisce l’impostazione generale.

Questo approccio è coerente con un requisito minimo per l’“intenzione” sugli indossabili: la decisione “mi sto attivando” dovrebbe avvenire localmente, con un indicatore chiaro, e con controlli rapidi per spegnere o limitare l’ascolto. Se l’utente deve fidarsi di un cloud per sapere se un microfono si è attivato, il gioco è perso.

Indicatori e “contratti” di interazione: il design conta quanto l’AI

Molti errori sugli assistenti non sono errori di modello linguistico. Sono errori di contratto: l’utente non capisce lo stato del sistema.

Sugli indossabili, l’indicatore deve essere:

- inequivocabile (suono breve, vibrazione, LED dedicato dove sensato),

- privato (non deve annunciare a tutto l’ambiente “sto usando l’assistente”),

- reversibile (stop immediato, “annulla”, “non era per te”).

Un esempio pratico: una vibrazione doppia “ti ho sentito” e una vibrazione lunga “sto registrando” sono più utili di una frase in voce. In cuffia, un “tic” audio brevissimo può comunicare attivazione senza interrompere la conversazione umana.

Qui l’empatia verso il lettore è concreta: chi lavora, vive in famiglia o condivide spazi sa che la tecnologia migliore è spesso quella che non imbarazza.

Tre rischi sociali che i team di prodotto sottovalutano

1) L’assistente come terzo incomodo

Quando un dispositivo “entra” in conversazione senza invito, crea frizione tra persone. Non serve un disastro privacy perché l’utente perda fiducia: basta l’ennesima intrusione.

2) L’ambiguità nelle case multi-utente

In salotto, chi sta parlando con chi? Un assistente che non gestisce bene identità e intenzione confonde voci, sbaglia profilo, mescola promemoria. Non è un bug: è un fallimento di architettura dell’esperienza.

3) La normalizzazione dell’ascolto

Anche se un’azienda promette elaborazione locale, l’utente interiorizza un’idea: “c’è sempre un microfono che potrebbe attivarsi”. La differenza tra potrebbe e sta è tecnica, ma l’ansia è psicologica. Per questo l’intenzione deve essere visibile e controllabile.

Un criterio operativo: misurare i falsi positivi come metrica primaria

Molti assistenti ottimizzano per “rispondere spesso”. Con gli indossabili, la metrica da inseguire è un’altra: falsi positivi per ora d’uso e tempo di recupero dall’errore (quanto rapidamente l’utente può spegnere, annullare, correggere).

È un modo pragmatico per evitare promesse vaghe. Anche i framework di gestione del rischio spingono verso misure e controlli, più che verso “intelligenza” astratta. Per un riferimento metodologico, il NIST AI Risk Management Framework è utile come bussola: non dà ricette UX, ma aiuta a ragionare in termini di rischio, impatto e mitigazioni verificabili.

Sul piano normativo, nel 2025 è difficile ignorare l’impianto europeo sulla governance dell’AI. Una pagina ufficiale da tenere a portata è quella della Commissione UE sull’AI Act: European Commission – Artificial Intelligence Act. Anche qui, il punto non è “citare la legge”, è interiorizzare che l’AI va progettata con controlli, trasparenza e responsabilità.

Cosa può aspettarsi il lettore nei prossimi 12–24 mesi (senza fantascienza)

1) Più gesti e più segnali locali: l’interazione diventerà una combinazione di voce + micro-interazione (tap, squeeze, sguardo). È la risposta naturale al problema dell’intenzione.

2) Più elaborazione sul dispositivo: non per marketing, ma per latenza e affidabilità. Se l’assistente deve capire “era per me?”, non può aspettare un round-trip di rete.

3) Più controlli granulari: “attivo solo con gesto”, “attivo solo con auricolari”, “attivo solo quando sono da solo”, “attivo solo in auto”. Non perché l’utente ami le impostazioni, ma perché l’intenzione cambia per contesto.

FAQ

Come si definisce davvero “intenzione dell’utente” con un assistente?

È la probabilità che l’utente voglia iniziare un turno di dialogo con l’assistente. Non coincide con la richiesta, ma con il permesso implicito o esplicito di ascoltare e agire.

Perché i falsi positivi sono più gravi sugli indossabili?

Perché l’assistente è più vicino al corpo e più presente nel contesto sociale. Un errore interrompe conversazioni e crea imbarazzo, e l’utente lo percepisce come perdita di controllo.

Qual è la soluzione più realistica oggi?

Una combinazione di segnali: gesto fisico o comando breve + indicatori chiari + elaborazione locale per la fase di “risveglio”. La voce da sola non basta.

Riferimenti:

- 1La wake word è una parola o frase che innesca l’ascolto attivo; idealmente è riconosciuta localmente, senza inviare audio al cloud, per ridurre il rischio privacy.