I token AI sono diventati la nuova unità di misura dell’economia digitale, e come ogni risorsa scarsa sotto pressione stanno già subendo il trattamento che i consumatori conoscono bene dai supermercati: meno contenuto, stesso prezzo. La shrinkflation — quella pratica per cui il produttore riduce la quantità senza toccare il cartellino — ha trovato terreno fertile nel mercato dei modelli linguistici. Anthropic, la società dietro Claude, ne è diventata il caso di studio più discusso del 2026. Mentre la domanda di token AI esplode, le regole del gioco cambiano in silenzio: capire perché è essenziale per chiunque utilizzi questi strumenti, personalmente o in azienda.

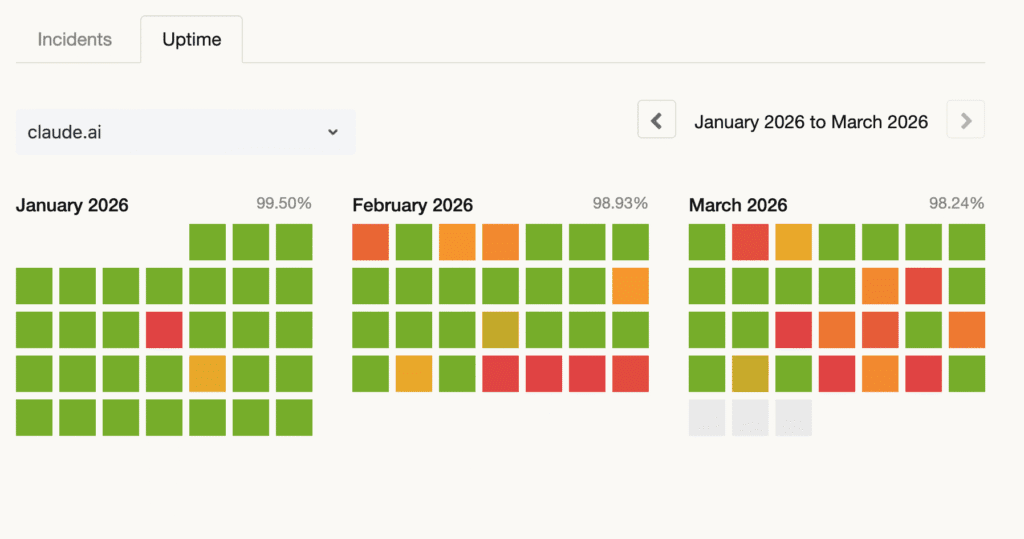

La vicenda si è accelerata dopo la disputa pubblica tra Anthropic e il Pentagono, che ha portato a un’attenzione mediatica senza precedenti su Claude e, di conseguenza, a un’impennata della domanda. In un mercato tradizionale, l’eccesso di domanda si gestisce con un aumento di prezzo. Qui si è scelto un percorso diverso: ridurre i token disponibili per gli abbonati, mantenendo invariato il costo mensile. Il risultato pratico è identico a quello di un produttore di biscotti che rimpicciolisce la confezione: paghi lo stesso, ottieni meno.

Indice dei contenuti

Cos’è la shrinkflation dei token AI

Il termine shrinkflation nasce nell’economia dei beni fisici, ma si adatta perfettamente al mondo digitale. Un token, nel contesto dei modelli linguistici, è l’unità base di elaborazione del testo: ogni parola, punteggiatura o frammento di frase corrisponde a uno o più token. Chi paga un abbonamento mensile a Claude Pro, ChatGPT Plus o Gemini Advanced ottiene un certo volume di interazioni. Quando quel volume si riduce senza che il prezzo cambi, si è di fronte a inflazione mascherata.

Anthropic ha giustificato la mossa con la necessità di gestire il carico infrastrutturale in un momento di domanda eccezionale. La spiegazione è tecnicamente comprensibile: i datacenter hanno capacità finite, i chip per l’inferenza AI sono costosi e difficili da reperire, e scalare richiede tempo. Ma dal punto di vista del consumatore l’effetto è lo stesso: meno per lo stesso prezzo.

“La scarsità di token non è un bug del sistema AI: è una scelta di business che rivela quanto questi mercati siano ancora immaturi e poco trasparenti.”

La differenza rispetto alla shrinkflation fisica è la visibilità. Quando il pacco di pasta passa da 500 a 400 grammi, basta guardare l’etichetta. Con i token AI, i limiti sono spesso comunicati in modo vago, modificati senza preavviso adeguato e difficili da monitorare per l’utente medio.

La disputa con il Pentagono e l’effetto domanda

La controversia tra Anthropic e il Dipartimento della Difesa americano ha avuto un effetto paradossale: ha reso Claude molto più visibile al grande pubblico, aumentando gli abbonamenti e, con essi, il consumo di token AI su scala massiva. Le aziende che cercavano alternative a OpenAI si sono rivolte a Claude in numeri superiori alle previsioni.

Anthropic si è trovata in una posizione classica da capacity crunch: troppa domanda, infrastruttura non ancora scalata a sufficienza. La risposta — ridurre i limiti invece di alzare i prezzi — è stata probabilmente una scelta di marketing oltre che operativa. In un mercato competitivo come quello degli assistenti AI, aumentare i prezzi avrebbe rischiato di spingere gli utenti verso i concorrenti. Tagliare silenziosamente i token è meno visibile, almeno nel breve periodo.

Questo schema non è esclusivo di Anthropic. OpenAI ha già modificato più volte i limiti di utilizzo di GPT-5 dentro ChatGPT Plus senza cambiare il prezzo di 20 dollari mensili. Google ha fatto lo stesso con Gemini Advanced. Il settore si sta normalizzando su una pratica che, nei mercati tradizionali, sarebbe oggetto di regolamentazione a tutela dei consumatori.

L’AI abbasserà davvero i prezzi? Il problema dei margini

Esiste una narrativa dominante secondo cui la diffusione dell’intelligenza artificiale porterà a un aumento generalizzato dell’efficienza nelle aziende e, di conseguenza, a una riduzione dei prezzi per i consumatori finali. È una tesi affascinante, ma storicamente fragile.

Il precedente dell’automazione industriale

L’automazione della produzione — dalla catena di montaggio ai robot — ha aumentato la produttività in modo drammatico. Ma i benefici si sono distribuiti in modo molto disomogeneo: i margini aziendali sono cresciuti, i salari reali dei lavoratori meno qualificati hanno ristagnato, e i prezzi al consumo sono calati solo in alcuni settori e con ritardi decennali. Non c’è motivo strutturale per cui l’AI si comporti diversamente.

Perché le aziende potrebbero non trasferire i risparmi

Un’azienda che adotta l’AI e riduce i costi operativi del 20% ha davanti due strade: abbassare i prezzi per guadagnare quote di mercato, oppure mantenere i prezzi e intascarsi la differenza come utile. La scelta dipende dal grado di concorrenza nel settore. In mercati oligopolistici — come le telecomunicazioni, il settore bancario o proprio il mercato dei modelli AI — la seconda opzione è storicamente quella preferita.

I dati post-pandemia lo confermano: molte aziende hanno usato l’inflazione come copertura per espandere i margini ben oltre il recupero dei costi aumentati. Il fenomeno è stato chiamato greedflation dagli economisti. Con l’AI il rischio è che si ripeta lo stesso schema: i risparmi di efficienza vengono trattenuti, i prezzi non scendono, e il vantaggio competitivo si traduce in rendite di posizione per chi controlla le piattaforme.

Impatto pratico per utenti e aziende

Chi usa AI in abbonamento personale

Per chi paga 20-22 euro al mese per un assistente AI, la riduzione dei token AI disponibili significa sessioni più corte, risposte troncate su documenti lunghi o la necessità di frammentare le richieste. È un peggioramento reale dell’esperienza, difficile da quantificare ma percepibile nel lavoro quotidiano. Chi usa questi strumenti per scrivere, programmare o analizzare dati lo avverte subito.

Chi integra API in prodotti aziendali

Le aziende che usano le API di Claude o GPT-5 pagano a consumo di token, quindi la shrinkflation degli abbonamenti consumer le tocca meno direttamente. Ma l’aumento dei prezzi per token — già applicato da Anthropic e OpenAI su alcuni modelli — incide sui costi di prodotto. Questo costo viene poi trasferito all’utente finale, o assorbito riducendo le funzionalità AI offerte gratuitamente.

Il mercato dei modelli open source

La pressione sui token AI degli abbonamenti commerciali sta accelerando l’adozione di modelli open source come Llama di Meta o Mistral. Chi ha le competenze tecniche per ospitare un modello in proprio paga solo l’infrastruttura, senza limiti imposti da terzi. Questa alternativa è ancora fuori portata per la maggior parte degli utenti, ma diventa sempre più accessibile grazie a strumenti come Ollama e alle GPU consumer di nuova generazione.

La questione della trasparenza

Il problema più serio non è la riduzione dei token in sé, ma la mancanza di trasparenza con cui avviene. Gli utenti meritano comunicazioni chiare sui limiti, sui cambiamenti e sulle motivazioni. L’assenza di standard di settore su questo fronte è una lacuna che le autorità di regolamentazione — in Europa più che altrove, grazie all’AI Act — potrebbero presto essere chiamate a colmare.

FAQ

Cos’è la shrinkflation dei token AI?

È la pratica con cui le aziende AI riducono il numero di token disponibili agli utenti in abbonamento senza modificare il prezzo mensile. L’effetto è identico alla shrinkflation dei beni fisici: si paga lo stesso ma si ottiene meno. Nel caso di Claude, il fenomeno si è intensificato dopo un picco di domanda legato alla disputa pubblica con il Pentagono.

Perché Anthropic ha ridotto i token invece di aumentare i prezzi?

In un mercato competitivo come quello degli assistenti AI, alzare i prezzi rischia di spingere gli utenti verso i concorrenti come ChatGPT o Gemini. Ridurre silenziosamente i limiti di utilizzo è meno visibile nel breve periodo e consente di gestire il carico infrastrutturale senza perdere abbonati. È una scelta di marketing oltre che operativa.

L’intelligenza artificiale farà davvero scendere i prezzi al consumo?

Non è garantito. I guadagni di efficienza generati dall’AI possono essere trasferiti ai consumatori tramite prezzi più bassi, ma possono anche essere trattenuti dalle aziende come margine aggiuntivo. In mercati poco concorrenziali, la seconda opzione è storicamente quella prevalente. Il precedente dell’automazione industriale mostra che i benefici si distribuiscono in modo molto disomogeneo.

Come posso sapere quanti token AI ho a disposizione nel mio abbonamento?

La maggior parte dei provider non comunica limiti precisi in modo trasparente: indicano soglie vaghe come ‘uso intensivo’ o ‘priorità ridotta nelle ore di punta’. Per monitorare il consumo reale, chi usa le API può tracciare i token via dashboard. Gli utenti degli abbonamenti consumer hanno meno strumenti e devono affidarsi alla documentazione ufficiale, spesso aggiornata in ritardo.

Esistono alternative agli abbonamenti AI commerciali per evitare i limiti di token?

Sì. I modelli open source come Llama di Meta o Mistral, eseguiti localmente tramite strumenti come Ollama, non hanno limiti di token imposti da terzi. Il costo è quello dell’hardware e dell’energia. Questa opzione richiede competenze tecniche minime ma sta diventando sempre più accessibile anche a utenti non esperti.

L’AI Act europeo potrà regolamentare la trasparenza sui token AI?

L’AI Act si concentra principalmente sui rischi sistemici e sulle applicazioni ad alto impatto, ma il tema della trasparenza contrattuale verso i consumatori rientra anche nel perimetro del Digital Services Act e delle normative sui diritti dei consumatori. È plausibile che le autorità europee intervengano su pratiche come la modifica unilaterale dei limiti di utilizzo senza adeguato preavviso.