Le API GLM rappresentano oggi una delle alternative più interessanti per chi cerca un modello di intelligenza artificiale dedicato al coding e al vibe coding. Mentre Claude e ChatGPT dominano il mercato, Z.ai ha costruito un ecosistema intorno ai modelli GLM che merita attenzione seria. La differenza è nei dettagli: nella struttura degli abbonamenti, nella configurazione delle API e nelle performance specifiche per lo sviluppo software.

Indice dei contenuti

Cos’è l’ecosistema Z.ai e i modelli GLM

Z.ai è una piattaforma cinese che offre accesso a diversi modelli di linguaggio, con particolare focus sulle prestazioni di coding. I modelli GLM (General Language Model) sono la famiglia principale, con diverse varianti ottimizzate per casi d’uso specifici.

- GLM-5: Il modello più recente, con performance di coding al pari di Claude Opus 4.5 (almeno così dicono loro)

- GLM-5.1: Una versione aggiornata di GLM-5, disponibile negli abbonamenti Pro e Max, non in Lite1Fonte: Documentazione Z.ai DevPack

- GLM-4.7: Un modello bilanciato, con varianti Flash e FlashX per task più veloci

- GLM-4.6 e versioni precedenti: Modelli legacy con performance inferiori ma costi ridotti

GLM-5 si distingue per la sua capacità di ragionamento a lungo termine e per essere progettato specificamente per l’automazione di task complessi, non solo per la conversazione. Lo stesso si può dire di GLM-4.7, che migliora significativamente le performance di coding rispetto alla versione precedente.

Le differenze tra i modelli GLM

GLM-5 vs GLM-5.1

La differenza principale tra GLM-5 e GLM-5.1 è nell’accessibilità. GLM-5.1 è una versione ottimizzata disponibile solo negli abbonamenti Pro e Max di DevPack, non nel piano Lite. In termini di performance, GLM-5.1 mantiene le stesse caratteristiche di GLM-5 con miglioramenti specifici per l’uso in contesti di coding agent, dove la coerenza a lungo termine è ancora più critica.

Per la maggior parte degli usi standard, GLM-5 e GLM-5.1 sono intercambiabili. La scelta si riduce alla disponibilità: se hai il piano Lite, dovrai usare GLM-4.7; se hai Pro o Max, puoi accedere sia a GLM-5 che a GLM-5.1.

GLM-5 vs GLM-4.7

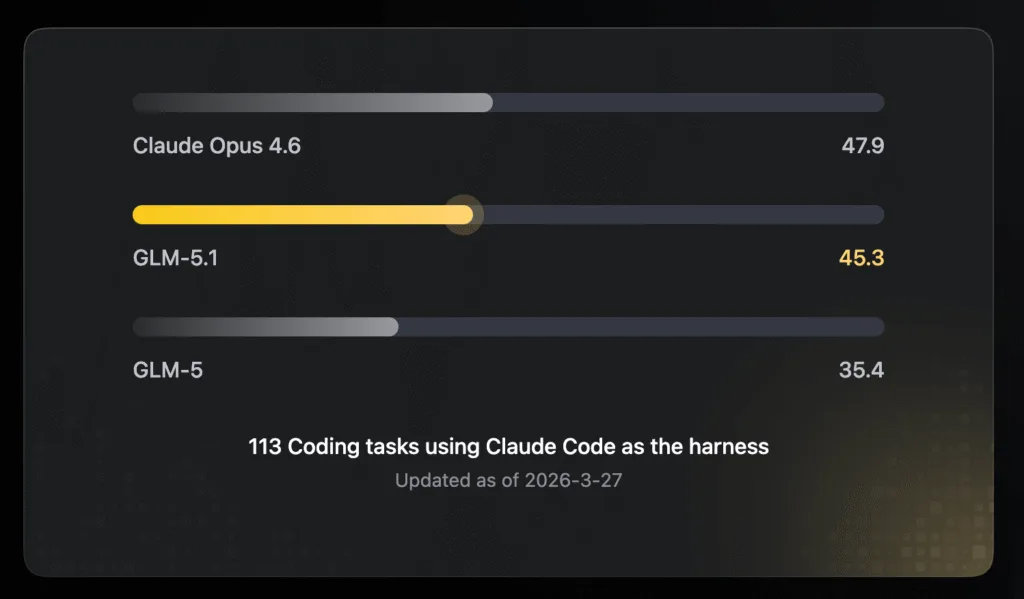

GLM-5 è il modello più avanzato dell’ecosistema, ma non è sempre la scelta migliore. Il vantaggio principale sta nelle performance di coding e nel ragionamento a lungo termine. Secondo i benchmark interni di Z.ai, GLM-5 raggiunge livelli di performance confrontabili con Claude Opus 4.5 nei task di programmazione.

GLM-4.7, d’altra parte, offre un equilibrio diverso. Le varianti GLM-4.7-Flash e GLM-4.7-FlashX sono ottimizzate per la velocità, sacrificando parte della capacità di ragionamento in cambio di tempi di risposta più rapidi. Questo le rende ideali per task di coding più semplici o quando la latenza è un fattore critico.

GLM-5-Turbo e GLM-4.6V

Oltre alle versioni principali, esistono varianti specializzate:

- GLM-5-Turbo: Una versione più veloce di GLM-5, con performance leggermente inferiori ma latenza ridotta

- GLM-4.6V: Un modello vision-language, capace di processare sia testo che immagini, utile per task che richiedono comprensione visiva

La scelta dipende dal tipo di lavoro: se devi analizzare screenshot di errori o documentazione con immagini, GLM-4.6V potrebbe essere la scelta giusta. Se invece cerchi pura potenza di ragionamento, GLM-5 è la strada maestra.

Context length e output tokens

Le differenze tra i modelli non sono solo nella qualità, ma anche nelle specifiche tecniche:

- GLM-5 supporta un context length di 128K token, con output fino a 8K token

- GLM-4.7 ha context length di 128K token, con output fino a 4K token

- Le varianti Flash possono avere limitazioni minori per massimizzare la velocità

Questo significa che GLM-5 è più adatto per task complessi che richiedono mantenere contesto lungo nel tempo, come la manutenzione di codebase estese o il refactoring di moduli interi.

GLM vs Claude e ChatGPT per il coding

Il confronto tra GLM, Claude e ChatGPT dipende dal tipo di lavoro di coding da svolgere. Non esiste un vincitore assoluto, ma vantaggi specifici per ciascuna piattaforma.

Performance pure di coding

I benchmark ufficiali di Z.ai mostrano che GLM-5 raggiunge performance paragonabili a Claude Opus 4.5 nei task di programmazione. In particolare, GLM-5 eccelle in:

- Refactoring di codice complesso

- Debug e identificazione di bug

- Generazione di codice multilinguaggio

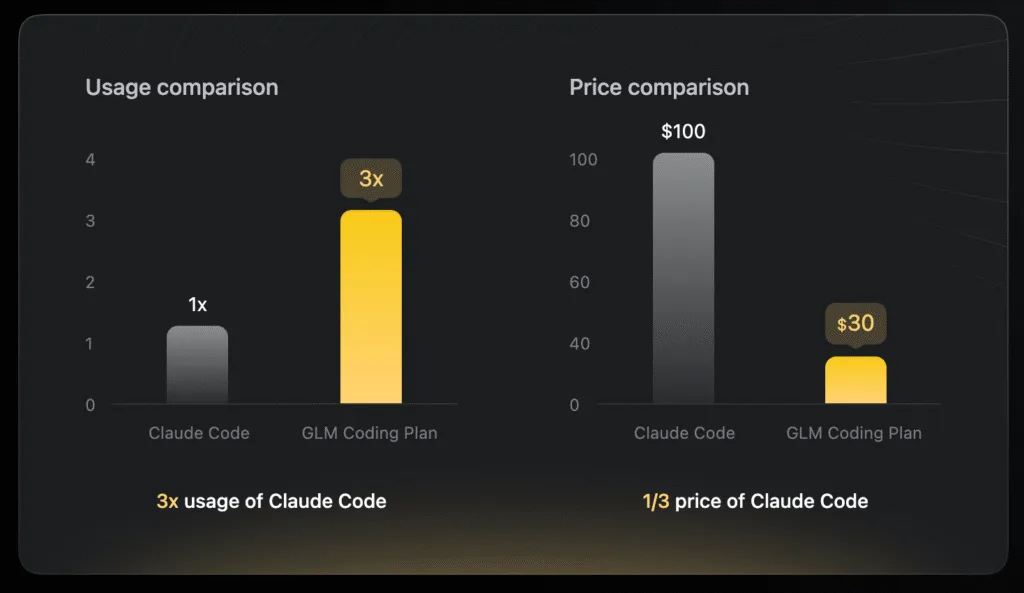

Personalmente l’ho trovato non all’altezza di Claude Sonnet 4.6 o GPT 5.4 di OpenIA. L’abbonamento base da 10 € al mese promette soglie 3x rispetto a quelle di Claude, ma il risultato non è ai livelli del motore più costoso.

Claude rimane forte nella coerenza a lungo termine e nella capacità di mantenere contesto complesso, ma GLM-5 sta riducendo il divario, specialmente nei task di automazione e agent-based coding.

Integrazione con tool di sviluppo

Un punto di forza dell’ecosistema Z.ai è l’integrazione nativa con i principali tool di coding. DevPack, il piano abbonamento, include:

- VS Code: Estensione ufficiale per completamento codice

- Cursor: Integrazione per AI-assisted coding

- Windsurf: Supporto per ambiente di sviluppo collaborativo

- OpenClaw e OpenCode: Tool open-source con integrazione GLM

Queste integrazioni sono native e non richiedono configurazioni complesse, a differenza di Claude e ChatGPT che spesso richiedono soluzioni di terze parti o API manuali.

Si integra per esempio anche con Craft Agents, per provare a creare progetti in vibe-coding. Risultati che personalmente ho trovato molto più scadenti rispetto all’uso di GPT 5.4.

Costi e abbonamenti

Qui la differenza è significativa. Mentre Claude e ChatGPT hanno piani di abbonamento più rigidi, Z.ai offre DevPack con tre livelli:

- Lite Plan: Fino a 80 prompt ogni 5 ore, fino a 400 prompt settimanali. Il prezzo è di 10 $ al mese.

- Pro Plan: Fino a 400 prompt ogni 5 ore, fino a 2.000 prompt settimanali. Include accesso a GLM-4.7, GLM-5 e GLM-5.1. Il costo è di 30 $ al mese

- Max Plan: Fino a 1.600 prompt ogni 5 ore, fino a 8.000 prompt settimanali. Include accesso completo a tutti i modelli GLM, inclusi GLM-5 e GLM-5.1. Il costo è di 80 $ al mese.

Se volete provare un mese, da questo link otterrete il 10% di sconto.

I limiti di DevPack si resettano dinamicamente ogni 5 ore dal consumo. Questo sistema è diverso da quello di ChatGPT, che conta i token mensili senza limiti orari, e può essere più o meno vantaggioso a seconda del tuo pattern di utilizzo.

Come usare le API di GLM

L’integrazione delle API GLM segue uno schema standard simile a quello di OpenAI, ma con alcune differenze nelle specifiche tecniche.

Setup rapido delle credenziali

- Crea un account su Z.ai

- Genera una API key dal dashboard

- Configura le variabili d’ambiente o i parametri di autenticazione

La API key viene usata come header di autenticazione nelle request HTTP, secondo lo standard Bearer token.

Chiamate API base

curl -X POST https://open.bigmodel.cn/api/paas/v4/chat/completions \

-H "Authorization: Bearer YOUR_API_KEY" \

-H "Content-Type: application/json" \

-d '{"model": "glm-5",\n "messages": [\n {"role": "user", "content": "Scrivi una funzione Python per ordinare una lista"}\n ],\n "temperature": 0.7\n }'SDK ufficiali

Z.ai fornisce SDK ufficiali per Python e Java, oltre alla compatibilità con l’OpenAI Python SDK2Fonte: Documentazione Z.ai DevPack. Questo semplifica la migrazione per chi usa già OpenAI.

from openai import OpenAI\n\nclient = OpenAI(\n api_key="YOUR_ZAI_API_KEY",\n base_url="https://open.bigmodel.cn/api/paas/v4"\n)\n\nresponse = client.chat.completions.create(\n model="glm-5",\n messages=[\n {"role": "user", "content": "Spiega come funziona il context caching"}\n ]\n)\n\nprint(response.choices[0].message.content)FAQ

Il piano Lite include GLM-5?

No, il piano Lite non include l’accesso a GLM-5 né GLM-5.1. Con il Lite Plan hai accesso solo ai modelli GLM-4.7 e precedenti. Per usare GLM-5 o GLM-5.1 devi sottoscrivere il piano Pro o Max.

Qual è la differenza tra GLM-5 e GLM-5.1?

GLM-5.1 è una versione aggiornata di GLM-5, ottimizzata per l’uso in contesti di coding agent. In termini di performance, GLM-5.1 mantiene le stesse caratteristiche di GLM-5 con miglioramenti specifici per la coerenza a lungo termine. La differenza principale è nella disponibilità: GLM-5.1 è accessibile solo con i piani Pro e Max, non con Lite.

GLM-5 è migliore di Claude per il coding?

Secondo i benchmark interni di Z.ai, GLM-5 raggiunge performance paragonabili a Claude Opus 4.5 nei task di programmazione. Claude ha ancora il vantaggio della coerenza a lungo termine e di una base di conoscenza più ampia, ma GLM-5 eccelle in refactoring, debug e automazione di task complessi. Personalmente credo che sia molto inferiore ai modelli di Claude.

Posso usare le API GLM con VS Code?

Sì, Z.ai fornisce un’estensione ufficiale per VS Code inclusa in DevPack. L’integrazione è nativa e non richiede configurazioni complesse. Supporta anche altre piattaforme come Cursor, Windsurf, OpenClaw e OpenCode, con SDK ufficiali per Python e Java e compatibilità con l’OpenAI Python SDK.

Qual è la differenza tra GLM-4.7 e GLM-4.7-Flash?

GLM-4.7 è il modello standard della famiglia 4.7, con buon equilibrio tra qualità e velocità. GLM-4.7-Flash è una variante ottimizzata per la velocità, con tempi di risposta più rapidi ma performance di ragionamento leggermente inferiori. È ideale per task di coding più semplici o quando la latenza è un fattore critico. Esiste anche GLM-4.7-FlashX, ancora più veloce ma con ulteriori compromessi sulla qualità.

Come ottengo una API key per le API GLM?

Devi creare un account su Z.ai e generare una API key dal dashboard delle impostazioni. La API key viene usata come header di autenticazione Bearer nelle request HTTP alle API GLM. Il processo è simile a quello di OpenAI, con l’unica differenza che l’endpoint base è https://open.bigmodel.cn/api/paas/v4.

Update: GLM-5.1 e il Vibe Coding — La Mia Esperienza Diretta

🔄 Aggiornamento aprile 2026: dopo aver usato intensivamente GLM-5.1 su Z.ai, devo ammettere che il flusso di vibe coding è migliorato tantissimo rispetto alle versioni precedenti. La qualità delle risposte in contesti di coding iterativo è cresciuta in modo evidente, e il modello riesce a mantenere il contesto su sessioni molto più lunghe senza perdere coerenza. Considerando i soli 10$/mese del piano Z.ai, non rimpiango Claude — e c’è una ragione concreta: Z.ai offre ben 3 volte i token inclusi rispetto a Claude Pro, il che fa una differenza enorme nel lavoro quotidiano con codebase articolate.

Riferimenti:

- 1Fonte: Documentazione Z.ai DevPack

- 2Fonte: Documentazione Z.ai DevPack